Por Deborah Becker

To read this article in English in WBUR, click here.

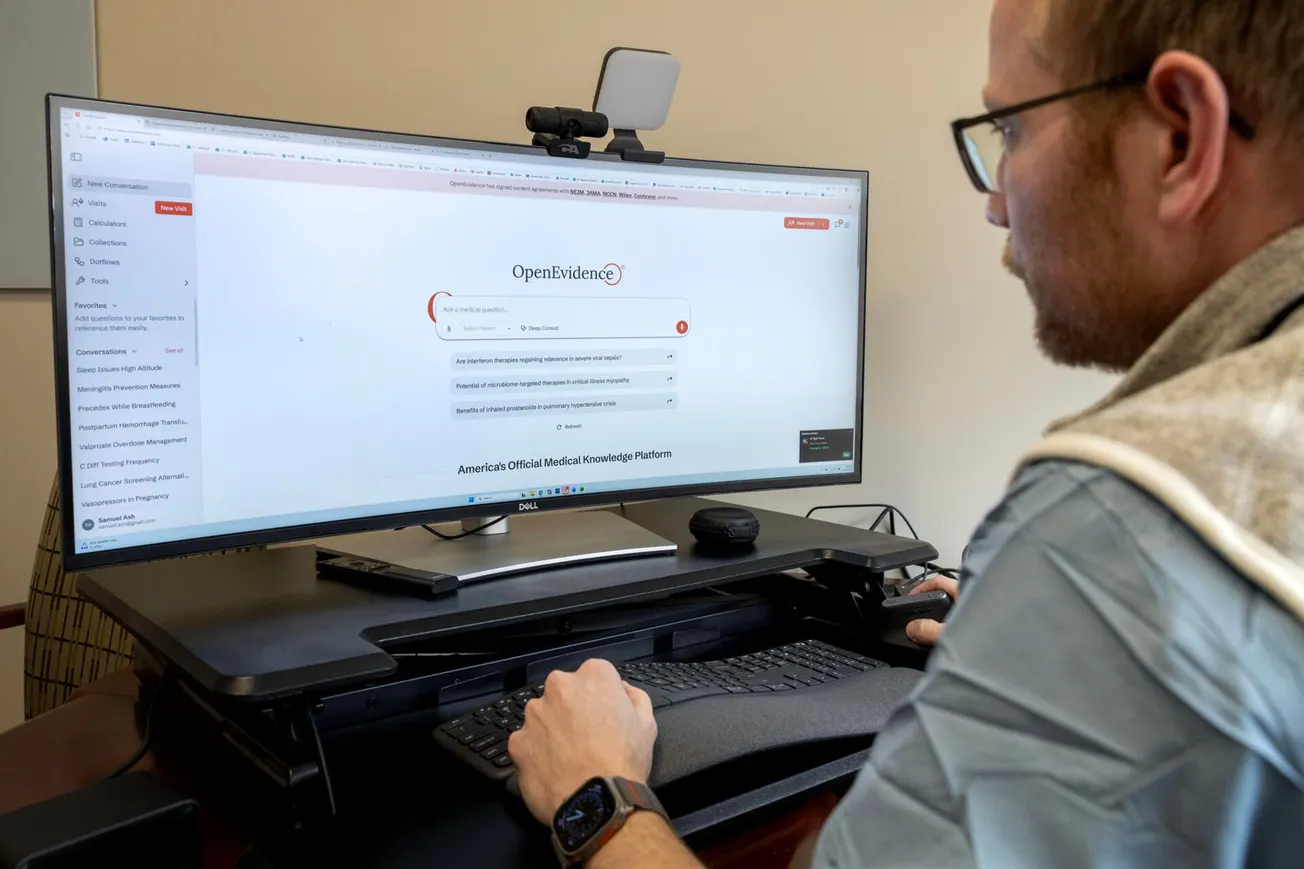

El Dr. Sam Ash, del South Shore Hospital, ingresó rápidamente en su computadora los detalles de una nueva paciente que fue llevada a la unidad de cuidados críticos tras ser encontrada inconsciente en un baño, rodeada de frascos de pastillas.

La mujer, de 40 años, tenía antecedentes de enfermedad mental, y entre los medicamentos encontrados a su lado había un fármaco para la presión arterial, un ansiolítico, el antipsicótico Seroquel y el anticonvulsivo Depakote.

El Depakote llamó especialmente la atención de Ash. En niveles suficientemente altos, explicó, puede ser tóxico y requerir diálisis para evitar que dañe los órganos de la persona.

“Esto es algo que sé, pero de memoria no recuerdo el nivel exacto”, dijo Ash, quien trata pacientes y también se desempeña como vicepresidente de tecnología de la información e innovación del hospital de Weymouth.

Ash abrió OpenEvidence, una plataforma de inteligencia artificial que los médicos utilizan cada vez más para ayudar en el diagnóstico de pacientes. Conocida a menudo como el “ChatGPT para médicos”, OpenEvidence es solo una de las poderosas herramientas de IA que el personal médico está adoptando para asistir en la atención de los pacientes.

Muchos médicos están utilizando “scribes” de inteligencia artificial para tomar notas durante las consultas con pacientes. Pero las herramientas de IA para diagnóstico también están entrando cada vez más en consultorios y hospitales, desde tecnologías que mejoran las tomografías computarizadas (CT scans) hasta chatbots de IA generativa que analizan enormes volúmenes de datos médicos y ofrecen recomendaciones.

Una encuesta reciente de la Asociación Médica Americana (American Medical Association) encontró que alrededor del 80% de los médicos utilizó IA en su trabajo el año pasado, el doble de la tasa registrada hace tres años.

Analistas estiman que el mercado global de la inteligencia artificial en el sector salud está valorado en 39 mil millones de dólares, una cifra que se espera crezca de forma explosiva en la próxima década.

El auge de esta tecnología dentro de la industria está generando tanto temores como esperanzas sobre lo que podría significar para la salud de los pacientes.

Aprender a confiar en las máquinas

Ash le pidió a OpenEvidence que verificara cuánto Depakote había en la sangre de su paciente y si ese nivel requería tratamiento intensivo. Las respuestas llegaron de inmediato: no necesitaba diálisis.

Pero la IA no se detuvo ahí. OpenEvidence le sugirió a Ash que revisara el corazón y la respiración de la paciente, y le recomendó preguntar si había tomado otros medicamentos adicionales.

“De alguna forma te recuerda: no te quedes fijado en la idea del Depakote — asegúrate de verificar que no haya tomado otra cosa cuya botella no se haya visto”, dijo Ash. “Esto ya forma parte de nuestro protocolo, así que es algo que ya hacemos, pero funciona como un recordatorio útil”.

OpenEvidence fue cofundada por un emprendedor de inteligencia artificial y un estudiante de doctorado de Harvard. Es gratuita, se financia mediante publicidad y ha experimentado un crecimiento meteórico en el último año. La empresa ha establecido alianzas con organizaciones como el New England Journal of Medicine. OpenEvidence estima que al menos el 40% de los médicos en Estados Unidos utiliza su herramienta de IA.

Ash señaló que una de las ventajas es que ofrece enlaces a fuentes primarias de información, como estudios médicos publicados. La comparó con un libro de referencia médica con investigaciones de respaldo fácilmente accesibles con un clic.

Y Ash enfatizó que no es la única herramienta que utiliza para ayudar a diagnosticar a los pacientes.

“Estoy consultando múltiples fuentes”, dijo Ash. “Empiezo con OpenEvidence, pero luego confirmo mi decisión y la información con la literatura de fuente primaria, o con algo que ya existe desde hace tiempo y que ha sido confiable y validado”.

Muchos médicos dijeron que no confían completamente en la inteligencia artificial. En la encuesta de la Asociación Médica Americana, una de sus principales preocupaciones fue mantener la confidencialidad de la información de los pacientes.

La política de South Shore establece que los médicos no deben ingresar información protegida de los pacientes en OpenEvidence, aunque Ash reconoció que es posible que los médicos cometan errores. Sin embargo, señaló que, a diferencia de otras herramientas en línea, OpenEvidence cumple con las leyes federales de privacidad médica. Y añadió que, sin este tipo de plataformas, las personas podrían recurrir a herramientas menos seguras.

“Las personas van a usar Google o van a usar ChatGPT, y eso es realmente lo que no queremos”, dijo Ash, porque entonces “no tenemos ninguna confianza de que lo que ingresen en esas herramientas de búsqueda vaya a permanecer privado de alguna manera”.

Ash dijo que entiende que muchas personas pueden sentirse incómodas con la idea de que los médicos dependan de una máquina para ayudar a diagnosticar sus problemas de salud. Sin embargo, señaló que los médicos son, en última instancia, responsables de las decisiones sobre el cuidado del paciente.

La inteligencia artificial sí tiene limitaciones, dijo Ash. A menudo no puede resolver casos médicos complejos, especialmente aquellos donde existen pocas referencias disponibles en línea de las cuales pueda aprender.

“El veredicto todavía no está claro sobre qué tan útil es en estos contextos”, dijo Ash. “A veces les digo a mis pacientes: ‘Aunque estemos en 2026, a veces todavía levantamos las manos y decimos: simplemente no estoy seguro’”.

Y la inteligencia artificial también puede no estar segura. Los investigadores han señalado que existen muchos ejemplos documentados en los que distintas herramientas de IA generativa —no OpenEvidence— han presentado falsedades como hechos, un fenómeno conocido como “alucinaciones”.

Un estudio realizado el año pasado por investigadores de Mass General Brigham encontró que algunos chatbots populares de IA operados por OpenAI, la empresa propietaria de ChatGPT, y Meta, priorizaban ser útiles sobre ser precisos al responder preguntas médicas. Los investigadores informaron que estas herramientas no eran capaces de identificar cuando una consulta era ilógica, lo que en ocasiones resultaba en respuestas falsas. Sin embargo, también encontraron que estos sistemas podían ser entrenados para mejorar su razonamiento.

A pesar de estas preocupaciones, varios expertos en seguridad del paciente señalaron que ven un gran potencial en la IA para reducir errores médicos. Los errores humanos ya representan un problema importante en el sector de la salud. Un estudio liderado por investigadores del Brigham and Women’s Hospital, publicado el año pasado, encontró que ocurre un error diagnóstico perjudicial en uno de cada 14 pacientes hospitalizados.

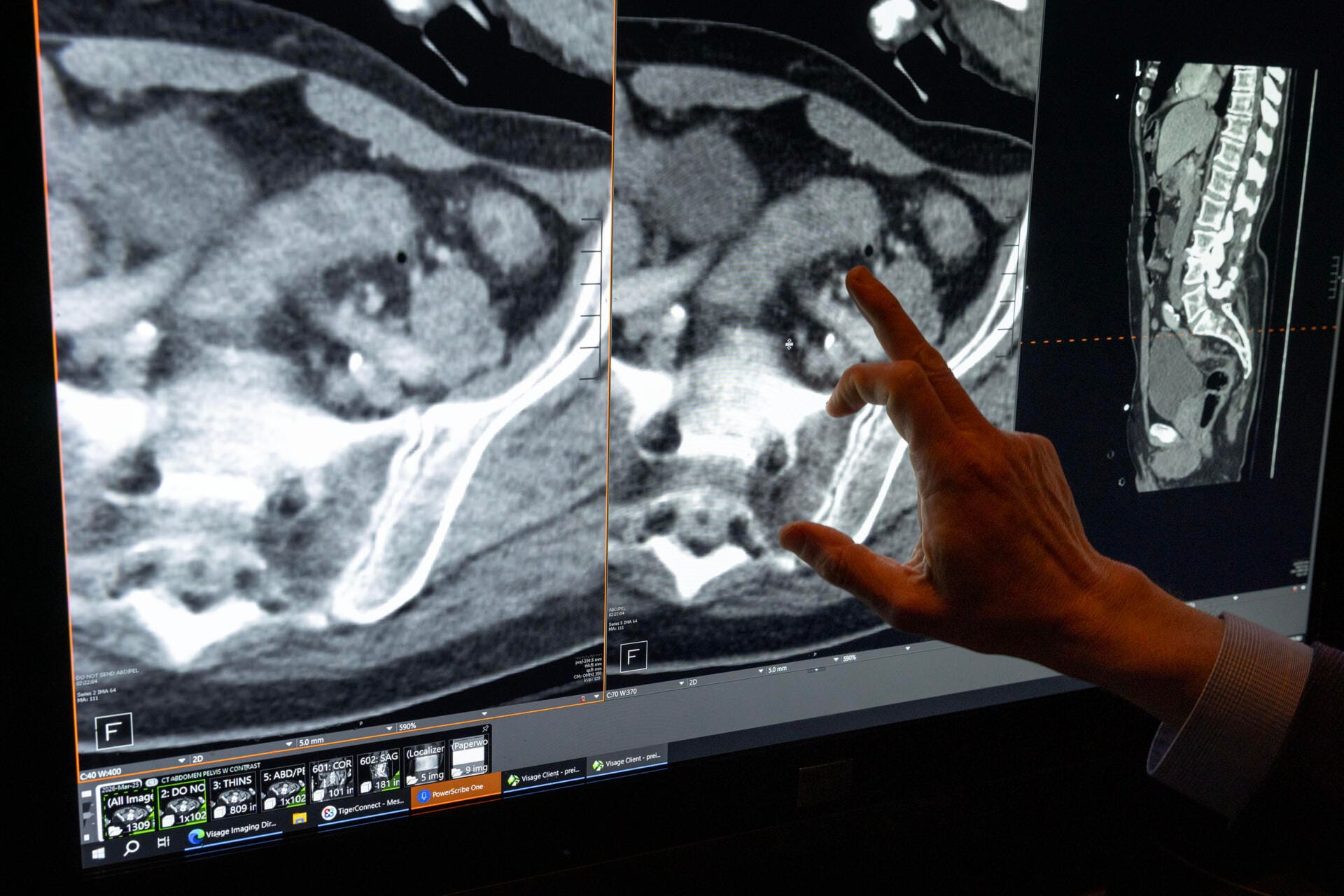

Otra área en la que la inteligencia artificial destaca, según estos expertos, es la radiología, que implica analizar imágenes como radiografías, tomografías computarizadas (CT scans) y mamografías, además de realizar estas tareas de manera rápida y precisa.

En muchas ocasiones en radiología, “la precisión en realidad mejora si usas IA en comparación con no usarla, en parte porque hace que todo el proceso sea mucho más eficiente”, dijo el Dr. David Bates, director ejecutivo del Center for Patient Safety Research and Practice del Brigham and Women’s Hospital.

Muchos hospitales de Massachusetts están utilizando inteligencia artificial en sus departamentos de radiología. En South Shore Hospital, los médicos usan una herramienta que puede mejorar las imágenes de tomografías computarizadas mientras reduce la exposición de los pacientes a la radiación.

El Dr. Ori Preis, jefe del departamento de diagnóstico por imágenes del hospital, mostró dos escaneos del abdomen de un paciente: uno generado con IA y otro sin ella. La imagen generada con inteligencia artificial era mucho más clara.

“La IA —mediante aprendizaje automático— ha aprendido a identificar qué es ruido y qué es realmente parte de la imagen, y así limpiar la imagen, permitiéndonos obtener la misma calidad con dosis más bajas de radiación”, explicó Preis.

Preis señaló que la IA muchas veces puede obtener imágenes claras utilizando entre un 30% y un 50% menos de radiación que una tomografía tradicional.

“La IA va a avanzar más rápido que nosotros”

No todos los trabajadores de la salud están entusiasmados. Algunos temen que la ola de inteligencia artificial esté inundando sus sistemas con tecnología para la que no fueron capacitados adecuadamente.

Joe-Ann Fergus, directora ejecutiva de la Massachusetts Nurses Association, dijo que las enfermeras deberían tener una mayor participación en la forma en que se implementa la IA en los lugares de trabajo del sector salud. Señaló que sus miembros están preocupados por varios temas, incluyendo posibles sesgos en los datos utilizados para entrenar la inteligencia artificial.

Fergus advirtió que pacientes de grupos subrepresentados en la investigación —como personas negras, latinas e indígenas, pacientes LGBTQ y mujeres— podrían quedar excluidos o ser diagnosticados incorrectamente.

“La gente está comprando estas herramientas ya hechas, y están entrenadas con poblaciones que no son las suyas”, dijo Fergus. “Y pequeños cambios hacen una gran diferencia, especialmente en lugares como nuestro estado, donde ya sabemos que existen disparidades en los resultados médicos. ¿Estamos incorporando desigualdades y sesgos dentro de estos sistemas?”

Fergus dijo que las enfermeras también están preocupadas por si podrían ser responsabilizadas por información o recomendaciones erróneas generadas por la IA, y por la posibilidad de que los profesionales pierdan habilidades en el trato con pacientes si dependen demasiado de estas herramientas.

“Estamos eliminando a los humanos del proceso, aunque digamos que no es así”, afirmó Fergus. “Nunca nos detenemos lo suficiente dentro del sistema para hacer las preguntas sobre por qué y cómo. Siempre se trata simplemente de introducir la novedad más llamativa, y siento que la IA va a avanzar más rápido que nosotros”.

Expertos en salud reconocieron que la inteligencia artificial requerirá nuevos mecanismos de supervisión, tanto por parte de administradores hospitalarios como del gobierno. Señalaron que la tecnología está evolucionando rápidamente y necesita límites y regulaciones para garantizar que realmente mejore la salud de los pacientes.

Los sistemas hospitalarios más grandes de Massachusetts —Mass General Brigham, Beth Israel Lahey Health y UMass Memorial Health— ya han creado juntas y oficinas dedicadas a establecer políticas y supervisar cómo el personal utiliza la IA. Sin embargo, todavía existe poca supervisión integral a nivel estatal y federal.

“Todo está ocurriendo muy rápido y el tema de la gobernanza sigue siendo muy incierto en este momento”, dijo la Dra. Tejal Gandhi, directora de seguridad y transformación de la empresa de gestión de salud Press Ganey. “Se necesita más orientación sobre qué debería ocurrir en cada nivel y qué tan regulado debería estar”.

En UMass Memorial Health, en Worcester, el presidente y director ejecutivo, Dr. Eric Dickson, dijo que el sistema hospitalario está realizando una inversión de 100 millones de dólares en inteligencia artificial y construyendo su propia plataforma de datos para entrenar sus herramientas de IA. Dickson espera que en el próximo año y medio el sistema pase de utilizar unas 60 herramientas de IA a alrededor de 300.

Dickson, quien ha completado programas de formación en IA en Stanford y Harvard, admite ser un entusiasta de esta tecnología. Considera que la IA es una “inteligencia aumentada”, no “artificial”. Sobre la mesa de su sala de conferencias tiene una pequeña figura negra de plástico etiquetada como “AI Ninja”, que entrega a médicos que también completan capacitaciones en IA.

Dickson dijo que planea ofrecer entrenamiento en distintos aspectos de inteligencia artificial a 21,000 trabajadores de UMass. Señaló que, sin esa preparación, los profesionales de la salud se quedarán atrás. También enfatizó que la IA siempre debe operar con los humanos liderando el proceso.

“La IA ya no es una opción”, dijo Dickson. “Viene en camino. No podemos apagarla, así que nuestro trabajo como humanos es descubrir cómo aprovecharla para el beneficio de nuestros pacientes —en mi caso particular— o de la sociedad en general”.